Os expertos advirten dos riscos de establecer un vínculo emocional coa intelixencia artificial

A intelixencia artificial "disfrázase de terapeuta" e iso implica riscos a nivel da saúde emocional

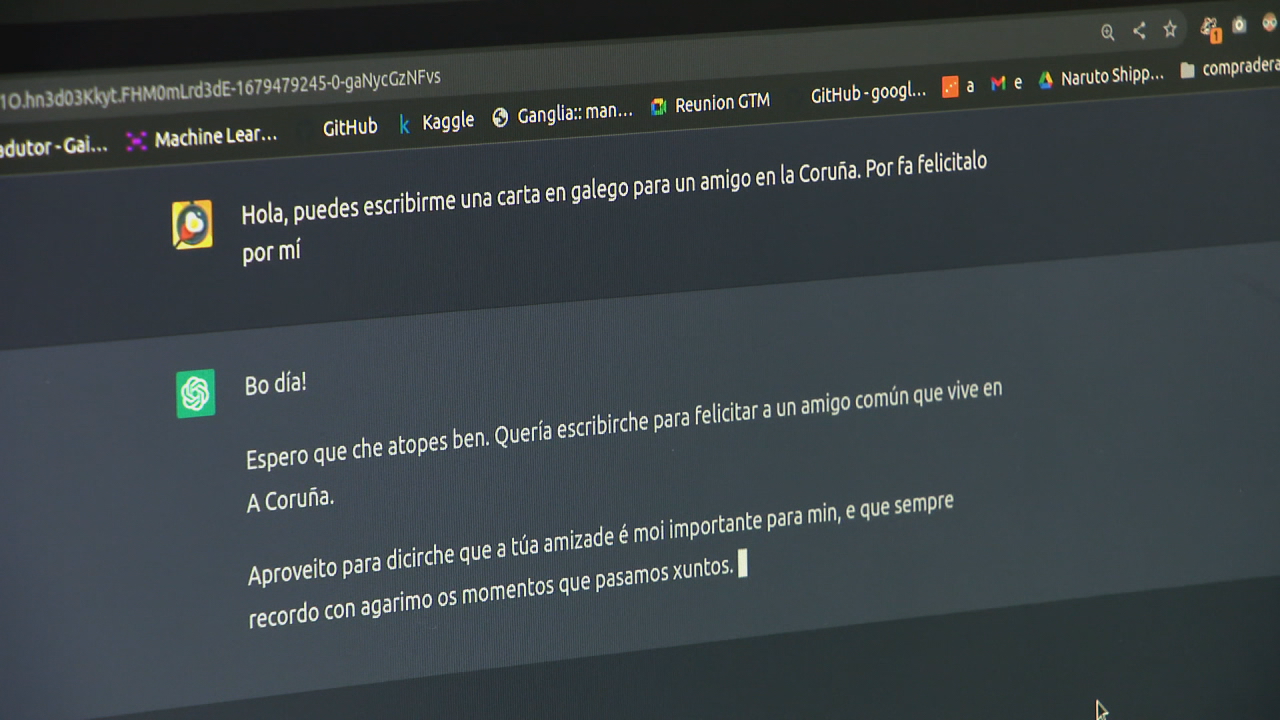

Os psicólogos aseveran que "Chat GPT non sente, non pensa como un ser humano, non sente empatía, pero simúlao moi ben"

Para moitas persoas, sobre todo entre a mocidade, o espazo principal de socialización son as redes sociais e moitos mesmo converten, por exemplo, o Chat GPT nunha ferramenta de acompañamento, para pedir consellos sobre temas persoais e respostas para resolver os seus problemas.

Os expertos advirten: a intelixencia artificial disfrázase de terapeuta e iso implica riscos.

"Algúns estudos americanos o que nos indican é que aproximadamente un 70 por cento dos adolescentes utilizan IA de xeito cotiá e que dese 70, un 70 por cento utilízano como acompañamento, como conselleiro emocional. É verdade que hai un nicho de negocio nese sentido e temos que estar atentos porque efectivamente substituír o vínculo humano polo vínculo cunha máquina ten repercusións a nivel da saúde emocional", di Ricardo Fandiño, psicólogo e vogal do Colexio Oficial de Psicoloxía de Galicia.

A intelixencia artificial non só dá respostas, formula preguntas e parece amosar interese polos problemas que se lle expoñen. Hai persoas que chegan a establecer un vínculo emocional ou de certa dependencia coa IA.

"O risco é que realmente non é un acompañamento, é a simulación dun acompañamento. Chat GPT non sente, non pensa como un ser humano, non sente empatía, pero simúlao moi ben", engade.

Un de cada tres nenos e adolescentes afirma que conversar cunha intelixencia artificial é como falar cun amigo. Os psicólogos destacan que hai dúas necesidades: regular o uso da IA e facer máis pedagoxía.

"É importante que os adolescentes non aprendan sós, temos que aprender con eles, temos que implicarnos e asumir de xeito corresponsable esa aprendizaxe, tanto desde o eido académico como desde as familias", destaca Ricardo Fandiño.